本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.ldbm.cn/database/52342.html

如若内容造成侵权/违法违规/事实不符,请联系编程新知网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

苹果CMS海洋CMS那个更容易被百度收录?苹果CMS站群

SEO优化和搜索引擎的友好性常常是网站管理员关注的重点。苹果CMS(maccmscn)和海洋CMS都是国内常见的CMS平台,但在搜索引擎优化(SEO)和百度收录方面,苹果CMS凭借其优秀的插件生态系统,特别是泛目…

大模型入门3:理解LLAMA

LLama在transformers库中的代码,以及各部分原理Llama3.1技术报告LLama 33b 微调尝试

Model

a stack of DecoderBlocks(SelfAttention, FeedForward, and RMSNorm) decoder block 整体结构:最大的区别在pre-norm

x -> norm(x) -> attention() -…

Unity实战案例全解析:PVZ 植物卡片状态分析

Siki学院2023的PVZ免费了,学一下也坏 卡片状态 卡片可以有三种状态:

1.阳光足够,(且cd好了可以种植)

2.阳光不够,(cd?好了:没好 (三目运算符)&…

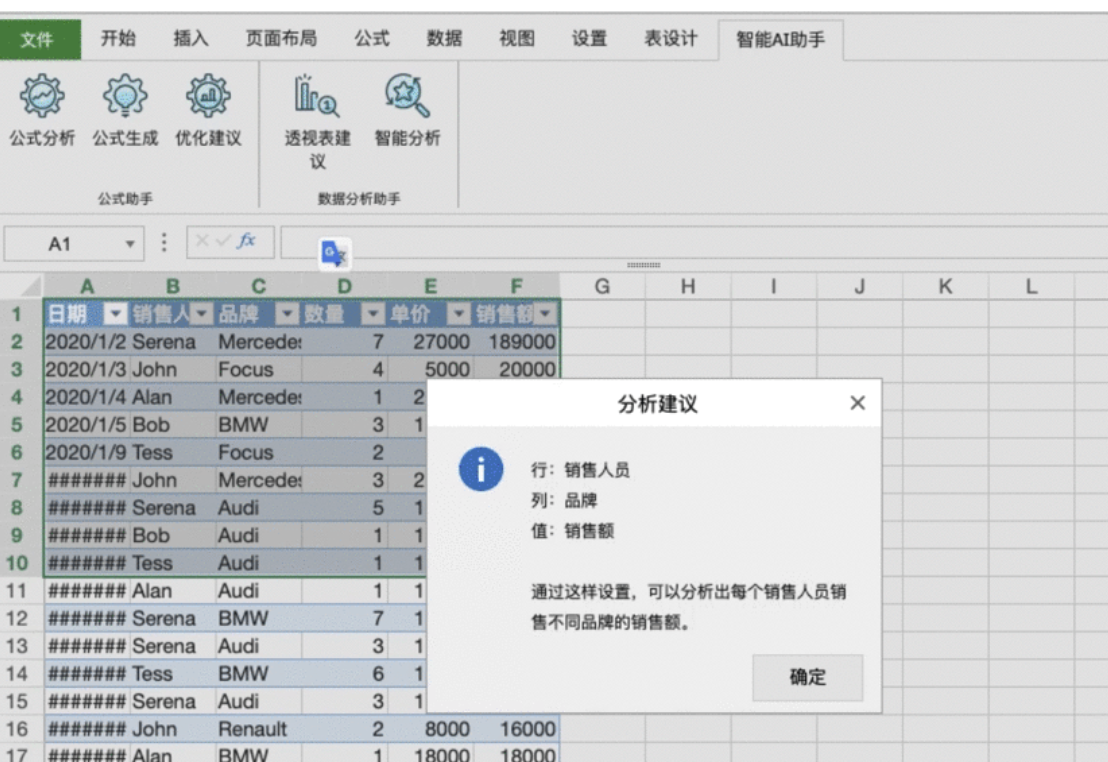

Excel 国产化替换新方案

前言

在当前数字化转型和信创(信息技术应用创新)战略背景下,企业对于安全性、自主可控性和高效办公工具的需求日益增加。作为一款国产自主研发的高性能表格控件,SpreadJS 正成为替换 Excel 的最佳选择。它不仅全面支持国产化认证…

王者荣耀改重复名(java源码)

王者荣耀改重复名

项目简介

“王者荣耀改重复名”是一个基于 Spring Boot 的应用程序,用于生成王者荣耀游戏中的唯一名称。通过简单的接口和前端页面,用户可以输入旧名称并获得一个新的、不重复的名称。

功能特点

生成新名称:提供一个接口…

Docker日志管理

ELK Filebeat Filebeat 是 ELK 组件的新成员, 也是 Beat 成员之一。基于 Go 语言开发, 无任何依赖, 并且比 Logstash 更加轻量, 不会带来过高的资源占用, 非常适合安装在生产机器上。轻量意 味着简单,Fileb…

标准库、HAL库、LL库

目录

举例理解

概念理解

标准库(Standard Peripheral Library,SPL)

2. HAL库(Hardware Abstraction Layer)

3. LL库(Low-Layer Library)

总结区别

如何选择

实际应用中的结合使用

代码…

十一,Spring Boot 当中配置拦截器的“两”种方式

十一,Spring Boot 当中配置拦截器的“两”种方式 文章目录 十一,Spring Boot 当中配置拦截器的“两”种方式1. 准备工作:2. Spring Boot当中配置拦截器的第一种方式:通过配置类的方式3. Spring Boot 当中配置拦截器的第二种方式&a…

【PyCharm】常用快捷键

此篇文章内容会不定期更新,仅作为学习过程中的笔记记录 PyCharm的所有快捷键,其实均可以自定义,在位于Settings -> Keymap的目录下(如图),可以自行改写为自己熟悉的键位组合。 若更改为PyCharm已存在的键…

边缘计算智能网关的功能应用与优势-天拓四方

在物联网的世界中,数以亿计的设备不断产生、传输和处理数据。然而,传统的云计算架构在面对这些实时性要求高、数据量庞大的物联网数据时,常常面临着网络延迟、带宽限制和安全风险等问题。这时,边缘计算智能网关作为一种新兴的技术…

learn C++ NO.16——模板

typename关键字

typename是一个c关键字,主要用于解决模板定义中的依赖类型名称的解析问题。它告诉编译器紧随其后的名称是一个类型,而不是静态成员或成员函数。在模板编程中正确使用typename是理解和编写复杂模板代码的关键。

那什么是模板定义中的依赖…

Acwing 区间合并

区间合并

主要思想:给定很多区间。若两个区间有交集,将二者合并成一个区间。 具体做法:

先按照区间的左端点进行排序然后遍历每个区间,根据不同的情况进行合并,有一下几种情况: 第一种情况,区间不变&…

ImDisk Toolkit将一部分RAM模拟成硬盘分区

ImDisk Toolkit 是一个用于虚拟磁盘管理的工具,它可以将 RAM(一部分内存)模拟成硬盘分区,从而创建一个高速的临时存储空间,通常称为“RAM Disk”。以下是如何使用 ImDisk Toolkit 来将一部分 RAM 模拟成硬盘分区的步骤…

VSCode 离线安装中文语言包

1.插件市场 Extensions for Visual Studio family of products | Visual Studio Marketplace 输入: language 在version history里面下载相应的版本,若没有就下载最新的

在下面安装 安装完重启就可以了。 可能会提示的失败:

Unable to ins…

灌区信息化发展趋势展望

灌区信息化作为现代农业发展的重要组成部分,正逐渐成为提升水资源管理效率、保障粮食安全与促进农业可持续发展的关键途径。随着信息技术的飞速进步和智能化技术的广泛应用,灌区信息化的未来发展趋势展现出多维度、深层次的变革与创新,其发展…

虚拟机Linux+Ubuntu操作系统 如何在虚拟机上安装docker VMPro 2024在线激活资源

一般情况下 不建议在windows系统上安装docker

Windows本身就自带一个虚拟机叫WSL 但是不推荐在日常使用的电脑上安装

我们要下一个虚拟机

我们在window上安装docker会被告知WSL内核太老

我们要一个专业的 隔离的虚拟机软件

推荐使用虚拟机

这是我们的虚拟机软件 我们这边…

用SpringBoot进行阿里云大模型接口调用同步方法和异步方法

同步效果就不展示了,这里展示更常用的异步,多轮异步流式效果展示如下: 结果内容组合 1、同步版本环境准备以及代码

需要开通阿里大模型服务,如果没有开通服务,单独的去生成 key 是无效的。

阿里云登录 - 欢迎登录阿里云,安全稳定的云计算服务平台 生成你需要的 key 1、…

Python基础语法(3)上

函数

函数是什么

编程中的函数和数学中的函数有一定的相似之处.

数学上的函数,比如 y sin x,x 取不同的值,y 就会得到不同的结果

编程中的函数是一段可以被重复使用的代码片段

代码示例:求数列的和,不使用函数

…