本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.ldbm.cn/p/110387.html

如若内容造成侵权/违法违规/事实不符,请联系编程新知网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

无涯教程-JavaScript - IMPRODUCT函数

描述

IMPRODUCT函数以x yi或x yj文本格式返回1到255个复数的乘积。两个复数的乘积为-

$$(A BI)(C DI)(AC-BD)(A B)1 $$

语法

IMPRODUCT (inumber1, [inumber2] ...)争论

Argument描述Required/OptionalInumber11 to 255 complex numbers to multiply.Required[inumbe…

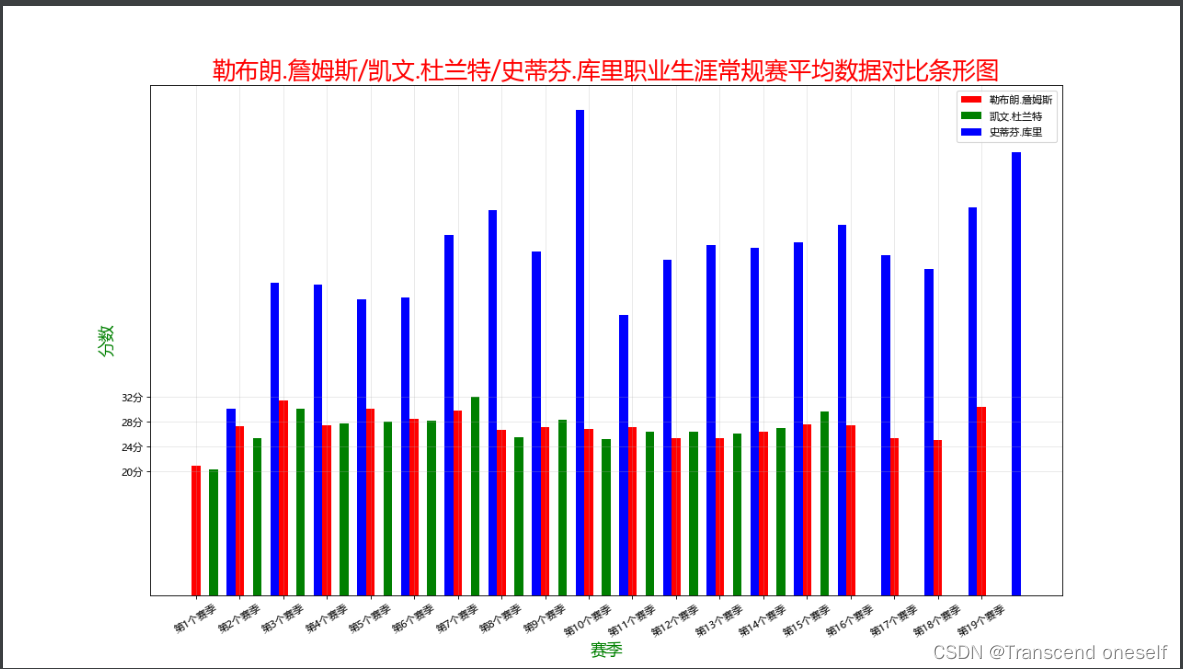

python数据分析-matplotlib散点图-条形图的绘制以及完整方法归纳02

matplotlib的基本使用02 一.散点图的绘制二.散点图绘图步骤及案例解析1.导入模块2.设置散点图所有字符的字体样式3.编写主体代码4.主题代码解析5.图形展示 三.条形图的绘制四.条形图案例展示1.导入模块 五.绘制条形图完整代码六.条形图展示七.多个条形图展示1.结果展示 八.总结…

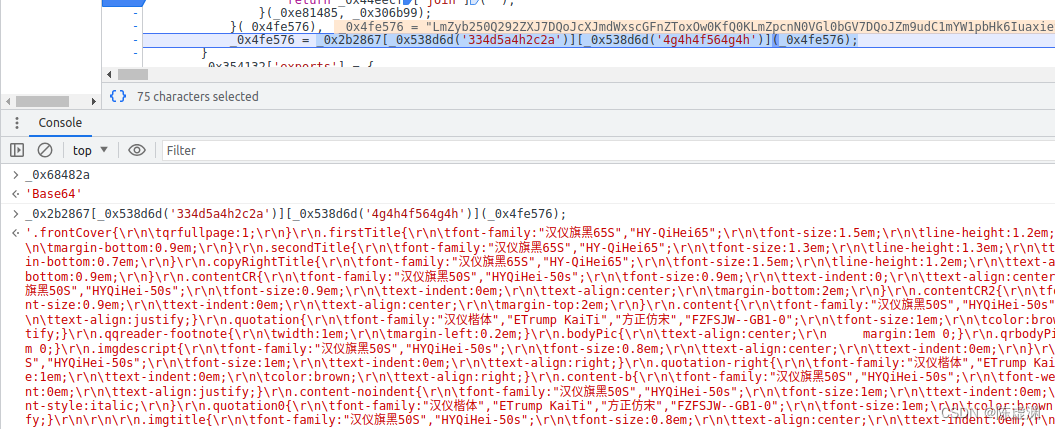

【微信读书】数据内容接口逆向调试01

需求爬取微信读书的某一本书的整本书的内容

增强需求,大批量爬取一批书籍内容

众所周知微信读书是一个很好用的app,他上面书籍的格式很好,质量很高。

本人充值了会员但是看完做完笔记每次还得去翻很不方便,于是想把书籍内容弄下…

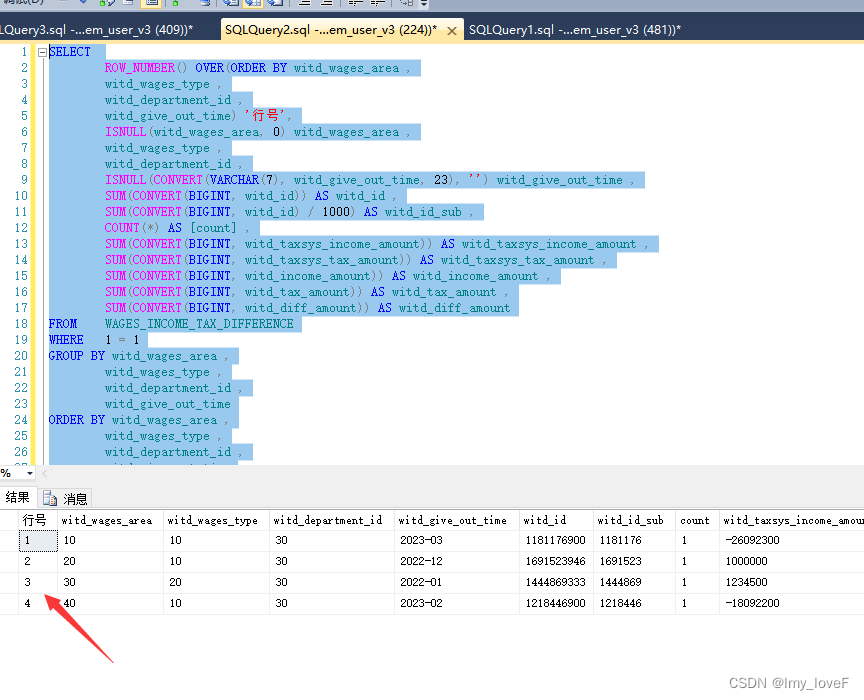

sqlserver 查询数据显示行号

查询的数据需要增加一个行号

SELECT ROW_NUMBER() OVER(ORDER BY witd_wages_area ,witd_wages_type ,witd_department_id ,witd_give_out_time) 行号,ISNULL(witd_wages_area, 0) witd_wages_area ,witd_wages_type ,witd_department_id ,ISNULL(CONVERT(VARCHAR(7), witd_gi…

LeetCode 729. My Calendar I【设计;有序集合,二分查找;线段树】中等

本文属于「征服LeetCode」系列文章之一,这一系列正式开始于2021/08/12。由于LeetCode上部分题目有锁,本系列将至少持续到刷完所有无锁题之日为止;由于LeetCode还在不断地创建新题,本系列的终止日期可能是永远。在这一系列刷题文章…

分布式调度 Elastic-job

分布式调度 Elastic-job

1.概述

1.1什么是任务调度

我们可以思考一下下面业务场景的解决方案:

某电商平台需要每天上午10点,下午3点,晚上8点发放一批优惠券某银行系统需要在信用卡到期还款日的前三天进行短信提醒某财务系统需要在每天凌晨0:10分结算…

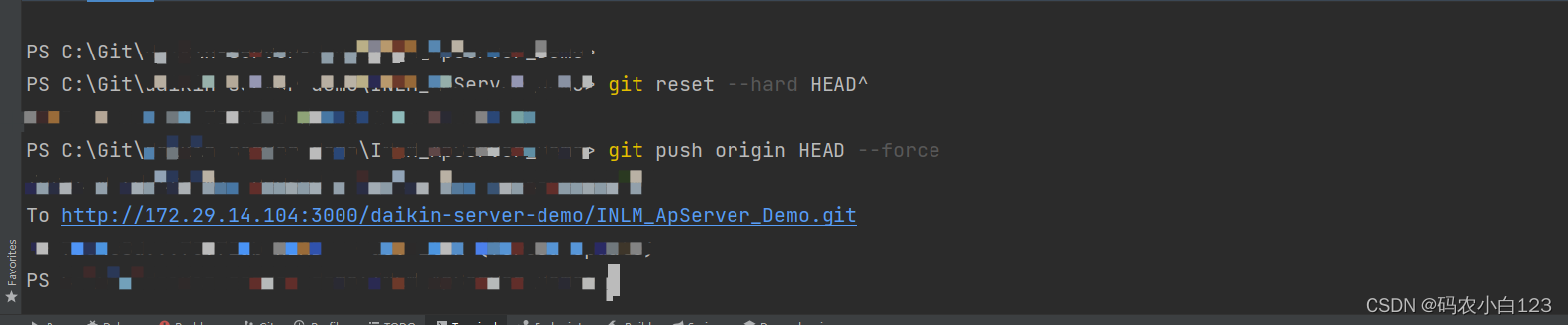

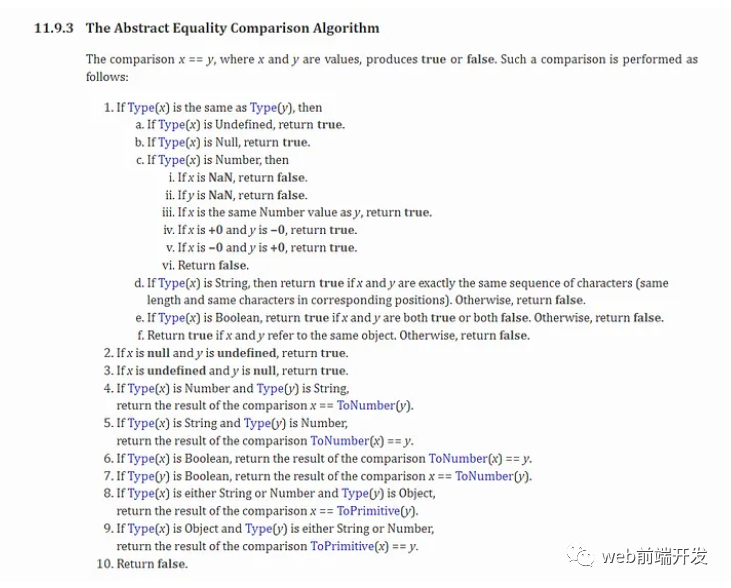

八个针对高级职位的高级 JavaScript 面试题

JavaScript 是一种功能强大的语言,是网络的主要构建块之一。这种强大的语言也有一些怪癖。例如,您是否知道 0 -0 的计算结果为 true,或者 Number("") 的结果为 0? 问题是,有时这些怪癖会让你摸不着头脑&…

autoware.ai感知随笔--地面滤波

autwoware.ai中点云预处理–points_preprocessor points_preprocessor cloud_transformer: 点云坐标转换,将输入的点云转化为velodyne坐标系下的点云。 compare_map_filter: 对比激光雷达点云和点云地图,然后提取(或去除)一致的点。

|input_…

机器学习实战-系列教程3:手撕线性回归2之单特征线性回归(项目实战、原理解读、源码解读)

🌈🌈🌈机器学习 实战系列 总目录 本篇文章的代码运行界面均在Pycharm中进行 本篇文章配套的代码资源已经上传 手撕线性回归1之线性回归类的实现 手撕线性回归2之单特征线性回归 手撕线性回归3之多特征线性回归 手撕线性回归4之非线性回归# 5…

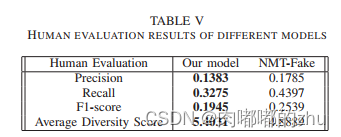

生成多样、真实的评论(2019 IEEE International Conference on Big Data )

论文题目(Title):Learning to Generate Diverse and Authentic Reviews via an Encoder-Decoder Model with Transformer and GRU

研究问题(Question):评论生成,由上下文评论->生成评论

研…

机器学习算法详解2:线性回归

机器学习算法详解2:线性回归 前言 本系列主要对机器学习上算法的原理进行解读,给大家分享一下我的观点和总结。 本篇前言 本篇对线性回归的算法原理进行解读。 目录结构 文章目录 机器学习算法详解2:线性回归1. 引子2. 原理3. 特点4. 问…

Rethink LSTMGRU

LSTM 设计思想 姑且不看偏置。 W W W 和 U U U 是加权的矩阵,写模型的时候用 nn.Linear(in_dim, out_dim) 就成; σ \sigma σ 是 Sigmoid 函数

第一条,遗忘门,定义为 有多少内容需要被遗忘;第二条:输入门…

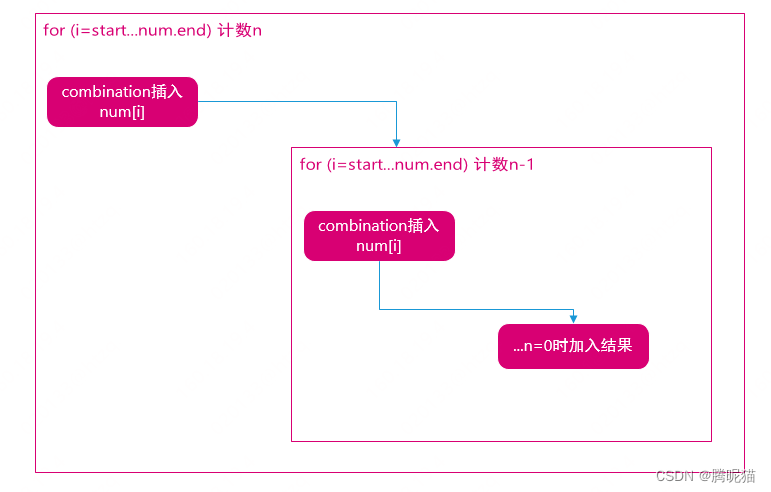

算法——组合程序算法解析

组合就是从m个元素的数组中求n个元素的所有组合,代码如下:

#include <iostream>

#include <vector>

using namespace std;

// 递归求解组合

void combinations(vector<int>& nums, vector<int>& combination, int star…

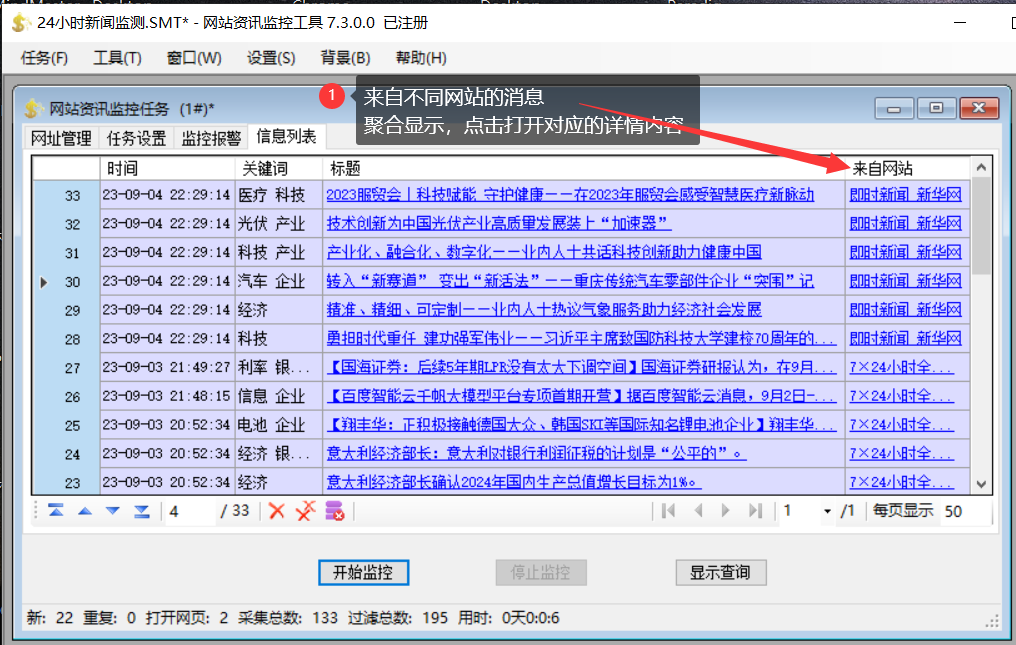

7X24即时新闻监测

即时新闻----是我们最快获取新闻内容的重要途径。一般内容简短精悍,更新频率高,很多字少事大的新闻首先在即时新闻里体现。即便是为我们及时获取新闻资讯带来方便,但我们仍然不可能一直盯着即时新闻页面看吧。我们希望当有重要新闻事件时&…

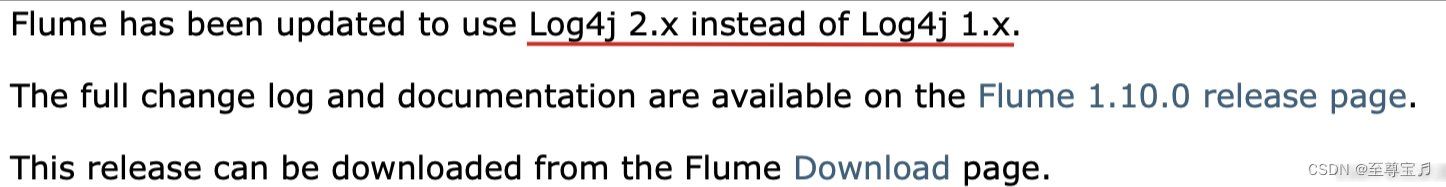

flume1.11.0安装部署

1、准备安装包apache-flume-1.11.0-bin.tar.gz;

上传; 2、安装flume-1.11.0; 解压;

tar -zxvf apache-flume-1.11.0-bin.tar.gz -C /opt/server 进入conf目录,修改flume-env.sh,配置JAVA_HOME;…

期权交易策略主要有哪些?期权交易策略指南

在学习更复杂的看涨和看跌期权策略之前,普通投资者应该彻底了解一些关于期权的基本知识,这样有助你后期的交易能力和理论知识水平提升有很大的帮助,下文科普期权交易策略主要有哪些?期权交易策略指南!本文来自…